窦文涛:人造生命打开潘多拉魔盒 人类多半会自取灭亡

人造生命对伦理造成很大冲击

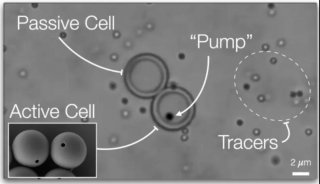

查建英:他就是悲观派,忧虑派,就是说一个东西一旦能人工合成制造出来,就可以自我繁殖,而且不断繁殖,以前所有美国科幻片的恐惧就是这儿来的,你造了一个机器人,你本来是要让机器人造福于人类,或者变成一种高智商的,人干不了的事,他都能解决,最后他变成统治人类了,然后毁灭人类。

窦文涛:我跟你说,这个事你还得看看,虽然咱们不懂科学,但是为什么奥巴马说这个事,得伦理审查,说明这个事很严重。

张鸣:就是对伦理造成很大冲击,你比如说过去我们讲,说迷信,迷信说轮回,说人死了以后要轮回,因为轮回之后,你不知道原来前生是谁,必须什么呢?在你投生的时候,给你孟婆茶,给你孟婆汤喝,喝糊涂了,你就投生了,否则你要不喝这个茶呢,出来以后,当妈的把孩子一生出来,孩子一睁眼,跟他妈说,我原来是你大爷。

窦文涛:你大爷的。

张鸣:这有可能啊,前世是你大爷,这不乱了嘛,全乱了,但是这种事就有可能。

窦文涛:我跟你说指日可期了,至少咱们看,有些事指日可期了,所以我跟你讲,有些事,人类已经要预做埋伏了,这个早就有人想到,未来机器人,甚至生物机器人,但是到时候怎么控制,就是你说那99个把我灭了怎么办,当然目前科学家控制,似乎还是在他里边打指令,你知道多少年前,有一个著名的科幻小说作家叫阿西莫夫,那个时候他就为人类设计了一个机器人三律令,机器人三定律,就是说不管怎么样,他已经琢磨好了,我发现这个逻辑还挺有意思。

这个阿西莫夫,他说机器人工学三定律,一定要给它设计这个命令。第一,机器人不可伤害人,或任人受到伤害而无所作为;第二,机器人应服从人的一切命令,但命令跟第一定律相抵触的时候例外。比如说张鸣让它杀窦文涛,那不行,它不能杀人。第三,机器人必须保护自身的安全,但不得与第一、第二定律相抵触。就是说你不能像人似的,为了自保,把你们两个灭了。