独特视角:从物理智能到微波视觉(二)

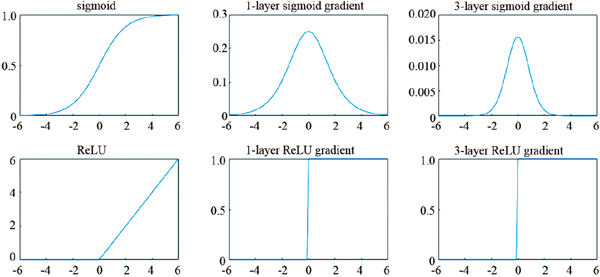

2006年,Hinton提出的“贪婪算法”训练多层自编码器引领了一批专家去研究深度神经网络,包括LeCun和Bengio等。深度神经网络之所以取得巨大成功,笔者认为其最核心算法改进在于采用了一类简化的激活函数,即规则化线性单元(rectified linear unit,ReLU)。由图3可知,ReLU本质上是分段线性函数y=max(0,x)。类似ReLU的激活函数事实上早在1975年即被提出[5],但是在1980年代被Sigmoid等具有良好非线性、连续可导、梯度计算复杂度低等优点的激活函数全面取代。一直到2009年,LeCun团队[6]在研究深度神经网络时,发现采用类ReLU的分段线性激活函数是实现对深度网络端到端训练的关键因素。2011年,Bengio团队[7-8]研究得到结论:深度神经网络最适合用ReLU作为激活函数,给出的理由包括ReLU与人脑神经元的相似性,因为神经元对某些输入完全没有反应,而对一些输入的反应呈单调关系,每一时刻处在激活状态的神经元总是稀疏的。这些工作为2012年Hinton团队[3]首次采用深度卷积网络赢得ImageNet 挑战赛奠定了理论基础。

图3 2种激活函数(Sigmoid,ReLU)及其单层、多层梯度比较

Fig. 3 Two types of activation function (Sigmoid, ReLU) and their single-layer, multi-layer gradients

关于ReLU优点,图3给出一种简单的解释,即其梯度在多层网络后向传播时能保持稳定,不像Sigmoid的梯度在累乘后容易达到饱和。关于ReLU的理论研究在2012年后还在继续,例如2015年LeCun团队[9]证明了深度神经网络的损失函数中的局部最小值均为较优解,且很容易被随机梯度下降算法找到,由此在理论上,它解释了深度神经网络取得巨大成功的一个主要原因。

可以看出,深度神经网络的本质是采用很多层嵌套的非线性函数来拟合海量的数据,监督学习即拟合高维数据空间中的一个曲面,而非监督学习如生成网络则拟合一种分布。至目前为止,真正解决实际应用问题的深度学习技术,无论在网络结构上有各种各样的创新,或者在训练优化算法上有各种各样的设计,都逃脱不了一个模式,即用海量的训练数据拟合一个包含海量未知数的复杂多层网络。

因此,笔者完全赞同图灵奖获得者Judea Pearl的观点:无论深度学习技术取得多大成功,各种相关研究多么五花八门,我们还没有突破其曲线/曲面拟合的本质[10]。不少学者已经开始反思深度学习面临的困境,由于其背后基础理论积累不足,深度学习技术很快就陷入一个瓶颈期。现在的深度学习相关技术过于简单,以致可以完全被计算机掌握,由于各种工具箱的出现使得绝大多数人可以轻易掌握深度神经网络应用技能,绝大多数人掌握这些技能后便快速陷入调参数、调结构的瓶颈。显然,这本身就是一份机械的工作,可以被人工智能取代。果然,谷歌公司于2018年初推出的AutoML工具即扮演了调参的角色,使得一大部分应用深度神经网络的人被深度神经网络取代。谷歌公司最新开发的AlphaGo Zero新版围棋程序也证明了靠机械的搜索来获得较优解决方案的工作也可以被取代。可以预见,更多的在研究网络结构和优化算法的科研人员也将被取代。深度学习技术的出现,预示着缺乏创造力的机械工作将会被取代。

因此,深度学习出现的意义首先是很好地利用了数据资源优势,实现超强拟合能力,解决各个领域的实际应用问题。其次它引发了人们对于人工智能技术的广泛关注,引领了一个大力研究智能科技的时代。然而,深度学习的超强拟合能力导致人们的期望过高,如果智能科学的基础理论迟迟没有突破,很快深度学习或人工智能就会跟不上人们对它的期望。

1.2 智能科学的诞生

人工智能深度学习技术的广泛应用必将要求智能科学的诞生。智能科学应是一门区别于自然科学和社会科学的崭新学科。它的诞生不仅仅与深度学习技术爆发有关,而且与脑科学、认知科学、理论神经科学、数据科学的发展密切相关,智能科学甚至还与一般自然科学和社会科学相关,这些学科是智能科学的前奏和基石。

智能科学是人工智能背后的基础科学,人工智能是建立于智能科学之上的一门应用学科。首先需要关心的是人工智能需要什么样的科学支撑。社会学家将广义人工智能分为3类:弱人工智能和强人工智能和超人工智能。弱人工智能是指擅长某一方面的人工智能,现阶段发展的人工智能就是弱人工智能。强人工智能指的是与人类比肩的人工智能,人类能做的事情它都能做。超人工智能就是科幻世界中经常出现的智力超越人类的人造机器。人工智能的目标可以归纳为4点——像人一样行动、像人一样思考、合理地思考、合理地行动。如果要使机器能像人一样思考的话,必须先弄清楚人类是如何思考的。这本身就是一件复杂而有趣的工作。有3种办法可以完成这项任务:通过内省——反思人类的思维方式;通过心理实验——观察被测对象,然后总结;以及通过脑成像——观察大脑的活动规律。然而,直到今天,人类对于自己大脑的运作原理以及人类思维等的认识仍然不足,认知科学还有诸多问题有待解决。

当前深度网络的巨大应用成功仅仅发源于人们对于视觉神经网络的理解和仿生。大脑和智能作为至今人类还没有研究透彻的领域,不断引起了科技界,乃至工业界和政府部门的重视。系统的脑科学研究主要分为自底向上的生物学研究和自顶向下的理论神经科学或认知科学研究,神经生物学通过生物观测实验手段从微观层面开始,不断向上积累基础知识,试图理解整个大脑的工作机制,例如通过神经元细胞切片的观察,一直到宏观尺度的大脑活动功能核磁共振(fMRI)成像等,神经生物学研究目前无法彻底理解大脑工作机制,主要局限于对活体大脑实时活动的微观观察手段的缺乏,近年来发展的荧光标记高分辨率光学成像技术将是该领域下一个突破口。理论神经科学或认知科学研究通过对人类宏观行为的理解建立数学理论模型以图仿制大脑智能。理论神经科学仿照牛顿物理学首先从数学上对大脑工作机制进行建模,通过假设的基本规律来逐步解释更复杂的大脑工作机制,与生物学手段比起来,理论神经科学的研究一直停滞不前。实验观测和理论建模必须有效结合,才能得到可靠的进展。例如通过观测发现的脉冲时间相关可塑性(SDTP)机制被认为是记忆和学习的神经化学基础,对于神经网络模型的构建具有重要推动作用。除了系统的脑科学研究,目前提及最多的是更接近应用层面的类脑人工智能算法(即深度学习)及其实现(即神经网络芯片),以及机器人外围技术(如机械骨架、仿生材料)。当前类脑人工智能算法与真正意义上的神经生物学的结合不够紧密,这将是下一代人工智能发展的方向之一。而机器人外围技术由于其在工业生产、家庭护理、国家安全等领域的重要应用得到重视,在人工智能技术的推动下,机器人可以实现的功能已快速接近以前只有在科幻世界中才出现的场景。

美国、欧盟、中国均已经或即将推出各自的大脑研究计划和人工智能战略,在神经生物学、类脑人工智能技术等方面开展研究。解开大脑的奥秘是开启未来智能世界的关键,是未来科技发展的战略制高点,谁掌握人工智能,谁将成为未来核心技术的掌控者。

人工智能及其相关技术日新月异,每周都有相关突破性进展报道。但是如前论述,深度学习本质即为超强函数拟合,其技术红利可能将很快被用尽。显然,目前的人工智能依旧处于弱人工智能范畴,走向强人工智能和超人工智能的道路依旧一团迷雾。在这个过程中,需要先解开大脑思维的奥秘,发展系统的智能科学。就像看到鸟的展翅飞翔,有了人类飞行的萌芽,但要发明飞机,则要发展现代航空力学与航空工业。

多名学者针对深度学习的火爆现象进行了冷静思考,并提出智能科学的研究建议。深度学习的引领人物也不停在反思,Hinton等[11]在深度学习进入火热的现象后,一直在思考,最近提出要推翻后向传播梯度下降的算法,认为人脑不是靠梯度下降学习,提出“胶囊网络”的新概念。LeCun[12]针对机器学习的发展也提出无监督学习与预测学习是机器学习的一个大方向。

此外,深度学习也受到来自机器学习其他领域学者的质疑,比如谷歌公司的Rahimi[13]在第31届神经信息处理系统大会(NIPS 2017)上公开将当前深度学习的研究比喻为“炼金术”,其本意就是批评当前大量的深度学习研究仅仅浮于网络结构和参数的不断调整尝试上,而没有试图建立一门基于严谨、周密、可验证的理论之上的科学。

正如人人会做的酿酒术,并不能容易产生近代化学一样。LeCun认为:工程总是先于理论,就像望远镜先于光学、蒸汽机先于热动力学、计算机先于计算科学等。对于此,麻省理工学院Poggio[14]则认为当前深度学习太依赖于数据,应该回归到理解人类智能上来,即脑科学和神经科学,比如首先解释人脑智能是如何产生的这样的根本科学问题。

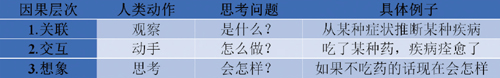

2011 年图灵奖获得者、贝叶斯网络的先驱JudeaPearl[10]最近发表论文阐述了机器学习理论的可能发展方向,认为当前深度学习的本质即函数拟合,其所关联的数据科学也只跟数据有关并没有科学。Pearl认为强人工智能的正确途径是引入因果关系,他将其分为关联(association)、交互(intervention)和想象(counterfactu⁃al)3个层面(图4[10])。当前深度学习仅停留在关联的层面,在交互的层面需要引入互动并观察其因果关系,而在想象层面则需要具备逻辑推理能力。最后,他提出应采用他本人发明的用于描述因果关系的贝叶斯网络等数学工具来研究下一步的强人工智能。

图4 Pearl的3层因果关系

Fig. 4 Pearl's three layers of casual relationship

加州大学洛杉矶分校朱崧纯[15]对人工智能从现状、任务到构架与统一进行了系统的阐述。他将人工智能学科分为6个方向:计算机视觉、自然语言理解与交流、认知与推理和机器人学、博弈与伦理和机器学习。他对于人工智能的一个观点也是与数据依赖性有关,认为人工智能不应该依赖大量数据,更应该关注人脑内在因素。认为智能科学是牛顿与达尔文理论体系的统一,提出应该把面向应用的人工智能变成智能科学。他提出一个很好的观点:“物理学把生物的意志排除在研究之外,而这正好是智能科学要研究的对象。智能科学要研究的是一个物理与生物混合的复杂系统。智能作为一种现象,就表现在个体与自然、社会群体的相互作用和行为过程中。我个人相信这些行为和现象必然有统一的力、相互作用、基本元素描述。”这是笔者所了解到的对智能科学最深邃的见解之一。

1.3 智能科学与物理智能

智能科学是智能时代所必须的支撑基础科学,它的内涵远不止当前的深度学习技术。智能科学应以人脑为支点,研究人与自然世界、人与人类社会的多体问题。但智能科学不能是孤立的研究人脑的科学。人脑是进化和后天学习的产物,生物进化给予人类一套可塑的神经组织,通过人与世界和社会的交互才形成了人类智能。人脑本身的结构组成和工作机制离不开外界对它的影响。可以想象一个初生的婴儿若一直孤独地生存在太空中,不与任何物质或信息交互,则不可能具备人类智能。所以说,人类智能是外在世界对人脑施加作用后所产生的反作用,外在世界与人脑智能是一双对偶问题。现有科学已经对外在世界建立较为成熟的理论体系。

因此智能科学应是一门以人脑为中心,研究人脑与自然世界相互作用、人脑与人脑相互作用,人脑与人类社会相互作用的学科。它不仅依赖于一套能描述人脑原理的数学理论,还需结合用于描述自然世界单体问题的自然科学和用于描述人类社会单体问题的社会科学。

按这一观点将人工智能分为下面4个阶段。

第1个阶段研究对象为人类智能的大脑原生组织结构,即自然进化赐予人类的可塑神经网络,借助于脑科学与计算神经科学等,发展一套可以建模大脑原生组织结构的数学工具,可以称之为数学智能。这一阶段的目的是用数学和计算工具描述和模拟初生婴儿大脑的通用组织结构和通用学习算法。

第2个阶段研究对象为外在物理世界加到人脑的“外力”导致在人脑中产生的“应力”,即人脑与物理世界交互后学会的适应物理世界并在其中生存的能力,可以称之为物理智能。物理智能即能适应客观世界的人工智能,如机器人。构造物理智能必须依赖数学智能和物理学。人类建立起来的强大的物理学理论体系有助于构造强于人类的物理智能,即比人类更适应物理世界的智能体,本文第2节讨论的微波视觉即属于这一范畴。物理智能可以推广到广义的自然智能,即研究能够适应各种自然科学现象的人工智能。

第3个阶段研究对象为他人或社会对于人脑的“外力”与所产生的“应力”,即人脑如何学会与他人相处、如何在人类社会中适应和生存的能力,可以称之为心理智能,或广义的社会智能。这个阶段研究智能与智能之间的高阶相互作用,也可称为高阶智能;则物理智能属于一阶智能,因为其研究范畴只涉及单个智能体。