常见机器学习算法优缺点比较(二)

常见算法优缺点

1.朴素贝叶斯

朴素贝叶斯属于生成式模型(关于生成模型和判别式模型,主要还是在于是否是要求联合分布),非常简单,你只是做了一堆计数。如果注有条件独立性假设(一个比较严格的条件),朴素贝叶斯分类器的收敛速度将快于判别模型,如逻辑回归,所以你只需要较少的训练数据即可。即使NB条件独立假设不成立,NB分类器在实践中仍然表现的很出色。它的主要缺点是它不能学习特征间的相互作用,用mRMR中R来讲,就是特征冗余。引用一个比较经典的例子,比如,虽然你喜欢BradPitt和TomCruise的电影,但是它不能学习出你不喜欢他们在一起演的电影。

优点:

· 朴素贝叶斯模型发源于古典数学理论,有着坚实的数学基础,以及稳定的分类效率。

· 对小规模的数据表现很好,能个处理多分类任务,适合增量式训练;

· 对缺失数据不太敏感,算法也比较简单,常用于文本分类。

缺点:

· 需要计算先验概率;

· 分类决策存在错误率;

· 对输入数据的表达形式很敏感。

2.LogisticRegression(逻辑回归)

属于判别式模型,有很多正则化模型的方法(L0,L1,L2,etc),而且你不必像在用朴素贝叶斯那样担心你的特征是否相关。与决策树与SVM机相比,你还会得到一个不错的概率解释,你甚至可以轻松地利用新数据来更新模型(使用在线梯度下降算法,onlinegradientdescent)。如果你需要一个概率架构(比如,简单地调节分类阈值,指明不确定性,或者是要获得置信区间),或者你希望以后将更多的训练数据快速整合到模型中去,那么使用它吧。

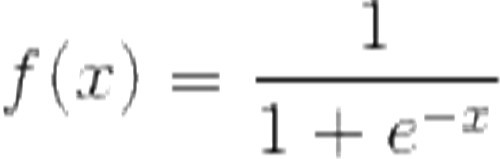

Sigmoid函数:

优点:

· 实现简单,广泛的应用于工业问题上;

· 分类时计算量非常小,速度很快,存储资源低;

· 便利的观测样本概率分数;

· 对逻辑回归而言,多重共线性并不是问题,它可以结合L2正则化来解决该问题;

缺点:

· 当特征空间很大时,逻辑回归的性能不是很好;

· 容易欠拟合,一般准确度不太高

· 不能很好地处理大量多类特征或变量;

· 只能处理两分类问题(在此基础上衍生出来的softmax可以用于多分类),且必须线性可分;

· 对于非线性特征,需要进行转换;

3.线性回归

线性回归是用于回归的,而不像Logistic回归是用于分类,其基本思想是用梯度下降法对最小二乘法形式的误差函数进行优化,当然也可以用normalequation直接求得参数的解,结果为:

![]()

而在LWLR(局部加权线性回归)中,参数的计算表达式为:

![]()

由此可见LWLR与LR不同,LWLR是一个非参数模型,因为每次进行回归计算都要遍历训练样本至少一次。