Nature解密类脑计算,人类未来需要一张蓝图

与日俱增的算力需求下,现代计算系统能耗也越来越高,很难作为可持续的平台支持人工智能技术的未来发展。这一能源问题很大程度上源于传统数字计算系统采用经典冯·诺依曼结构,即数据处理和存储需要在不同地方进行;而在人脑中,数据处理和存储在同一个区域完成,且大规模并行。生物学的灵感启发了类脑计算,神经形态系统可以处理非结构化数据、完成图像识别、对噪声和不确定数据集进行分类、并参与建构更优的学习和推断系统,有望从根本上改变处理信号和数据的方式,无论是在能源效率方面,还是在处理现实世界的不确定性方面。然而,目前对神经形态计算的关注和投资远远落后于数字人工智能和量子技术,该如何发挥神经形态计算的潜力?近期发表于 Nature 的文章认为,类脑计算亟需一幅宏大蓝图。

研究领域:类脑计算,神经科学,人工智能

论文题目:

Brain-inspired computing needs a master plan

论文链接:

https://www.nature.com/articles/s41586-021-04362-w

摘要

类脑计算(Brain-inspired Computing,或译作“脑启发计算”)向我们描绘了一幅美好的愿景:按照根本不同的方式以极高的能源利用效率处理信息,并且能够处理人类正在增速产生的越来越多的非结构化与噪声数据。要想实现这样的愿景,我们亟需一张宏图,在资金、研究重点等方面提供支持,将不同的研究团体协调地聚集在一起。昨天,我们在数字技术上如此走过;今天,在量子技术上一如既往;那么明天,在类脑计算上所做的是否也应如此?

背景

现代计算系统能耗过高,不能作为可持续的平台支持日益应用广泛的人工智能技术的发展。我们仅仅关注了速度、准确度、每秒并行操作数等功能,而忽略了可持续性,特别是在基于云的系统(Cloud-based Systems)的例子中。瞬间获取信息的习惯让我们忘记了实现这些功能的计算机系统会带来怎样的能源和环境消耗。例如,每次谷歌搜索都有数据中心的支持,而这样一个数据中心每年大约使用200太瓦时(terawatt)的能量,预计到2030年能耗还将增加一个数量级[1]。无独有偶,在高端人工智能系统中,以DeepMind引以为傲的、能够在复杂策略游戏中击败人类专家的 AlphaGo 和 AlphaGo Zero 为例,它们需要数千个并行处理单元,每个单元的功率大约200瓦,远超人脑的约20瓦[2]。

尽管并非所有数据密集型运算都用得上人工智能和深度学习,我们仍然需要担心应用越来越广的深度学习所带来的环境成本。此外,我们还应考虑包括物联网(Internat of Things, IoT)和自主机器人代理(Autonomous Robotic Agents)等不需计算密集型深度学习算法的应用,减少其能耗。若能耗需求过高,需要接入无数设备来运行的物联网也就无从谈起。分析表明,激增的算力需求远超摩尔定律(Moore's Law)带来的提升,算力需求翻倍现在只需要两个月(图1a)[3]。通过智能架构和软硬件协同设计的结合,我们正在取得越来越显著的进步。以NVIDA的图形处理器(Graphics Processing Units, GPU)为例,其性能自2012年已经提高了317倍,远超摩尔定律的预言(图1b),尽管与此同时,处理器能耗从25W增长到320W。研究与开发阶段不凡的性能提升(图1b,红色部分)昭示着我们可以做得更好[4-5]。但遗憾的是,单靠传统的计算解决方案无法满足长期需求。当想到大多复杂深度学习模型惊人的高训练成本时,这种遗憾尤其明显(图1c)。因此,我们需要新的出路。

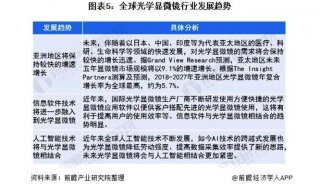

图1:算力需求迅速增长。(a) 展示了在过去的40年中计算能力需求的增长,算力统计单位是petaFLOPS days:直到2012年,计算能力需求每24个月就翻一番,仍然是符合摩尔定律的增速;然而最近已经缩短到大约每2个月。不同颜色表示不同的应用领域[3]。(b) 展示了过去五年中人工智能硬件效率的提高:最先进的解决方案使计算效率提高了300多倍,研究和开发的解决方案有望进一步改进[22-24]。(c) 则展示了自2011年以来人工智能模型培训成本与日俱增。

能源问题很大程度上源于数字计算系统处理数据和储存数据是在不同地方,也就是支撑数字计算系统的经典冯·诺依曼结构(von Neumann Architecture),这种结构决定了处理器要在移动数据上花费大部分的时间和能源。幸而生物学所带来的灵感给我们指了一条新的出路——在同一个区域完成储存与处理,以一种完全不同的方式编码信息,或者直接对信号进行操作,并采用大规模并行,这将在方框1中展开论述。其实,能源利用的高效和高级功能的行使可以兼得——我们的大脑就是明证。当然,关于我们的大脑如何做到兼得这二者,还有太多需要探索的奥秘。我们的目标并非仅仅简单模仿生物系统,而是要向过去几十年中神经科学与计算神经科学的重大进展当中找到出路。我们对大脑的了解已足以用来激发灵感。

生物学的启示

在生物学中,数据存储并非独立于数据处理,比如人脑——主要是神经元和突触——以大规模并行和适应性的结构行使这两种功能。人脑平均包含1011个神经元和1015个突触,消耗大约20瓦功率;而一个相同大小的人工神经网络的数字模拟消耗7900千瓦[6]。这六个数量级的差距无疑是对我们的挑战。大脑直接以极高的效率处理噪声信号;这与传统计算机系统中时间和能源消耗巨大的信号-数据转换和高精度计算形成鲜明对比,即使是最强大的数字超级计算机对于大脑也是望尘莫及。因此,类脑计算系统(另译作神经形态计算)有望从根本上改变我们处理信号和数据的方式,无论是在能源效率方面,还是在处理现实世界的不确定性方面。

当然,这个想法的产生在科学发展历程中也是有迹可循的。“神经形态”(neuromorphic)一词描述的是模仿生物神经系统部分功能的设备和系统,在20世纪80年代末由加州理工学院的卡弗·米德(Carver Mead)创造[7-8]。灵感来自于过去几十年的工作,将神经系统建模为等效电路[9],并构建模拟电子设备和系统,以提供类似的功能。

-

焦点事件

-

焦点事件

-

焦点事件

-

项目成果

-

科技前沿

-

科技前沿

-

产品技术

-

科技前沿

-

焦点事件

-

焦点事件

-

项目成果