食品检测技术--电子鼻和电子舌的应用之定量分析方法

1、支持向量机

SVM 是一种基于统计学习理论的机器学习算法,同人工神经网络类似,支持向量机也可看作是一种学习机器,通过对训练样本的学习,掌握样本的特征,对未知样本进行预测。最小二乘支持向量机(least square support vector machines,LS-SVM)是经典 SVM 的一种改进,以求解一组线性方程代替经典 SVM 中较复杂的二次优化问题,降低了计算复杂度。Alessandra 等在奶粉掺杂物的定量分析时,将 LS-SVM 与近红外光谱结合建立的预测模型的精度优于偏最小二乘回归法。杨宁的研究表明 LS-SVM 总体上明显优于 BP 神经网络。

2、多元线性回归分析

多元线性回归分析(multiple linear regression,MLR)的基本原理与一元线性回归分析是相同的,只是计算要求复杂得多,其数学原理涉及线性代数,但随着电子计算机的逐步普及以及与之相应的软件的日益开发,该统计分析方法已被逐渐推广。

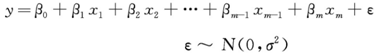

多元线性回归的数学模型如下。

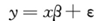

设因变量为y,它受到 m 个自变量x1,x2,…,xm-1,xm 和随机因素ε的影响。多元线性回归数学模型为:

(1-1)

(1-1)

式中,β0,β1,…,βm为回归系数。

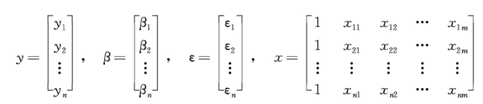

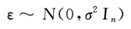

对 y 和 x1,x2,…,xm-1,xm 分别进行 n 次独立观察,取得 n 组样本,则有:

(1-2)

(1-2)

其中,ε1,ε2,…,εn 相互独立,且服从 N(0,σ2)分布。

令

则式(1-2)可以用矩阵形式表示为:

(1-3)

(1-3)

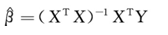

系数向量的最小二乘估计为:

(1-4)

(1-4)

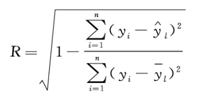

方程的显著性检验由两部分组成:一部分是对方程拟合误差的验证,用复相关系数R完成;另一部分是对方程回归系数的检验,用统计量t来完成。

(1-5)

(1-5)

3、主成分回归分析

主成分回归分析(principal component regression analysis,PCR)是在主成分分析的基础上,利用各主成分的互不相关性,以主成分作为新的自变量进行回归的方法。主成分回归分析可以消除多重共线性的问题。

4、偏最小二乘回归分析

在克服变量多重相关性对系统回归建模干扰的努力中,1983年,瑞典伍德(S.Wold)、阿巴诺(C.Albano)等人提出了偏最小二乘回归分析(partial least square regression,PLSR)方法,在处理样本容量小、解释变量个数多、变量间存在严重多重相关性问题方面具有独特的优势,并且可以同时实现回归建模、数据结构简化以及两组变量间的相关分析。

在偏最小二乘法分析中将采用以下一些参数来评价模型的性能:

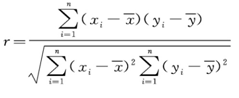

预测值与测量值的相关系数r(correlation coefficient):

(1-6)

(1-6)

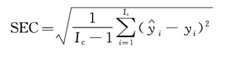

校准的标准误差 SEC(standard error of calibration):

(1-7)

(1-7)

预测的标准误差 SEP(standard error of prediction):

(1-8)

(1-8)

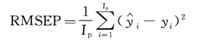

预测的平均误差 RMSEP(the mean squared error of prediction):

(1-9)

(1-9)

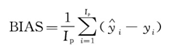

预测值与实际值之间的差异 BIAS(systematic difference between predicted and measured values):

(1-10)

(1-10)

式中, 为预测值;yi 为实际值;Ic 为校准数据集的数量;Ip 为确认数据集的数量。

为预测值;yi 为实际值;Ic 为校准数据集的数量;Ip 为确认数据集的数量。

在本实验中,PLSR 通过把独立的浓度矩阵进行组合来优化反应数据矩阵和预测值之间的相关性。首先,采用已知样本(用于建立模型的样本要在期望的浓度范围内具有代表性)建立校正曲线模型,得到的相关系数表明模型的好坏程度,之后用来预测未知样本的量化信息。

5、BP 神经网络

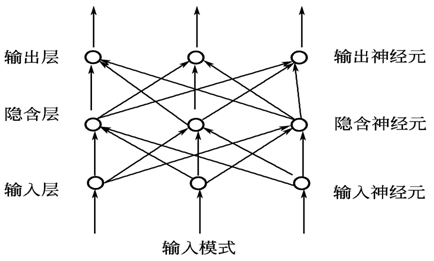

BP(back propagation) 网络是1986年由以 Rumelhart 和 Mc-Clelland 为首的科学家小组提出的,是一种按误差逆传播算法训练的多层前馈网络,是目前应用最广泛的神经网络模型之一。BP 网络能学习和存贮大量的输入-输出模式映射关系,而无须事前揭示描述这种映射关系的数学方程。它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小。如图1-1所示,BP 神经网络模型拓扑结构包括输入层(input layer)、隐含层(hide layer)和输出层(output layer)。

图1-1 BP 网络

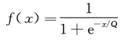

BP 算法是在电子鼻领域应用最多的一种算法。该算法功能强大,易于理解,训练简单。BP 算法不仅有输入节点、输出节点,还可有1个或多个隐含层节点。对于输入信号,要先向前传播到隐含层节点,经作用函数后,再把隐含层节点的输出信号传播到输出节点,最后输出结果。节点的作用激励函数通常选取 S 型函数,如:

(1-11)

(1-11)

式中,Q 为调整激励函数形式的 Sigmoid 参数。BP 算法由两部分组成:信息的正向传播与误差的反向传播。在正向传播过程中,输入信息从输入层经隐含层逐层计算传向输出层,每一层神经元的状态只影响下一层神经元的状态。如果在输出层没有得到期望的输出,则计算输出层的误差变化值;然后转向反向传播,通过网络将误差信号沿原来的连接通路反传回来修改各层神经元的权值直至达到期望的目标。